L’avvento dei media sintetici e dei contenuti generati dall’intelligenza artificiale (IA), come i deepfake, rappresenta un momento critico per la veridicità dell’informazione. Con un realismo crescente e una diffusione facilitata, si affaccia il rischio del “liars dividend“: la possibilità di screditare contenuti autentici affermando che siano stati creati con l’IA.

Comprendere i Limiti del Rilevamento AI

Strumenti di rilevamento IA si basano su dataset misti (immagini reali e generate) ma mostrano limiti di generalizzazione. Se il contenuto è creato con un modello non incluso nell’addestramento, la rilevazione può fallire. Inoltre, le tracce forensi sono deboli e facilmente cancellabili da operazioni comuni (compressori, condivisioni, ritagli).

La robustezza alle modifiche è scarsa, e l’interpretazione dei risultati spesso vaga: cosa significa un punteggio di integrità dell’80%?

Strategie Pratiche per i Giornalisti

- Verificare la fonte: controllare l’origine e l’affidabilità del contenuto.

- Cercare copertura alternativa: trovare lo stesso contenuto su fonti attendibili.

- Tracciare l’originale: risalire alla prima pubblicazione.

Analisi tecniche utili:

- Glitch analysis: cercare artefatti visivi sospetti.

- Analisi dei metadati: utile ma manipolabile.

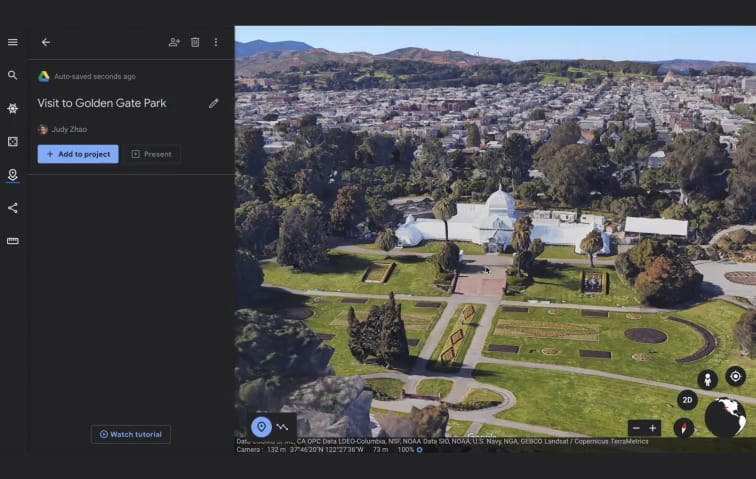

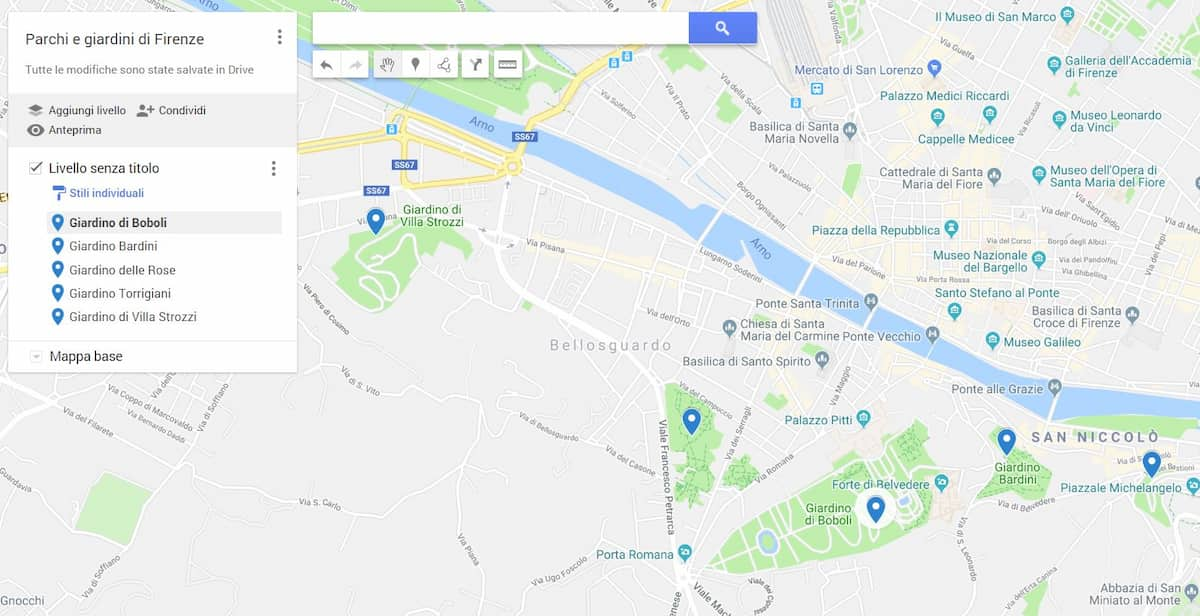

- Tecniche OSINT: per verificare contesto e geolocalizzazione.

Uso consapevole dei rilevatori AI:

- Confrontare più strumenti per incrociare i risultati.

- Capire su quali dati e modelli sono stati addestrati.

- Non fidarsi ciecamente dei tool pubblici online.

- Collaborare con esperti e fact-checker.

Affrontare il “Detection Equity Gap“

Molti giornalisti nel Sud globale non hanno accesso a strumenti e formazione. È urgente garantire equità nell’accesso e nel supporto tecnico e linguistico.

Il Futuro del Giornalismo e l’IA

L’IA può aiutare anche in modo positivo: nell’analisi dati, nel miglioramento di immagini e nella ricerca. Ma servono spirito critico ed etica.

Sono in fase di sviluppo metodi attivi di protezione, come filigrane digitali o etichette IA obbligatorie. Anche le piattaforme dovrebbero assumersi la responsabilità e rendere trasparente l’origine dei contenuti.

I giornalisti devono affrontare l’era dell’inganno AI con scetticismo informato, strumenti OSINT, formazione continua e collaborazione interdisciplinare. Solo così si potrà preservare la fiducia nell’informazione e nel suo valore democratico.