Secondo l’inchiesta del giornalista investigativo francese Jean-Marc Manach, oltre 4.000 siti di notizie false generati con intelligenza artificiale generativa sono stati creati in pochi mesi con l’obiettivo di manipolare gli algoritmi di Google, in particolare Google Discover, per ottenere visibilità e guadagni pubblicitari.

“Non avrei mai immaginato che quei 70 siti web di informazioni sull’intelligenza artificiale di nuova generazione che avevo scoperto un anno fa mi avrebbero permesso di scoprirne più di 4.000 da allora. È un’impresa da Sisifo”, ha raccontato Manach alla Press Gazette.

Come funziona la truffa

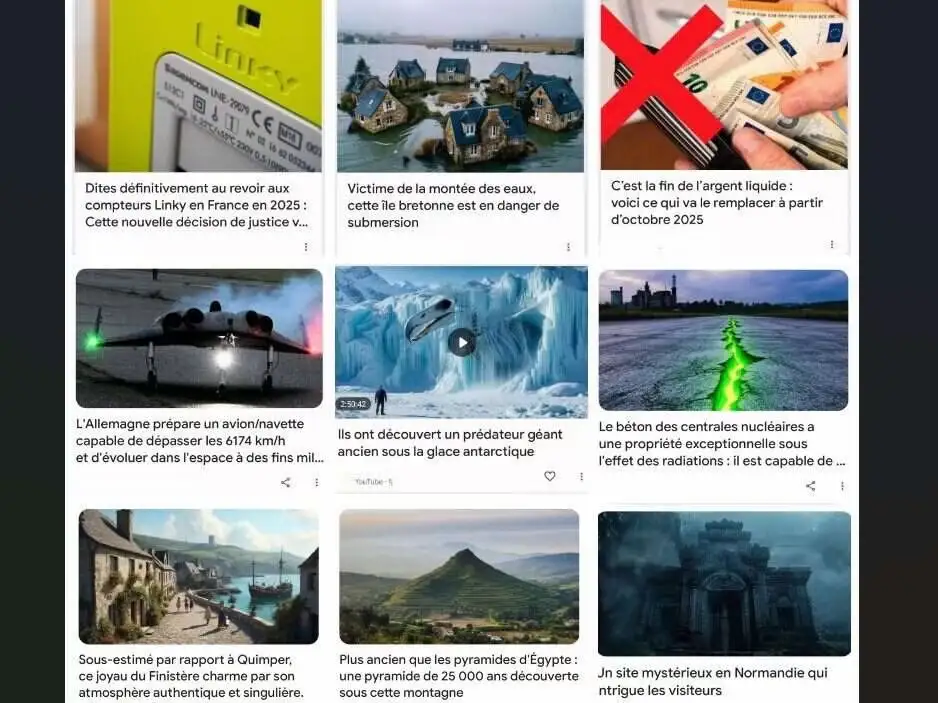

I siti pubblicano contenuti inventati, copiati o allucinati dall’IA, utilizzando strategie SEO per scalare le classifiche e posizionarsi nei feed personalizzati. Lo scopo è attirare clic e monetizzare con Google Adsense, sfruttando l’ignoranza degli utenti e la difficoltà delle piattaforme nel distinguere contenuti autentici da quelli sintetici.

Tra le bufale circolate: il ritiro delle banconote in Francia entro ottobre 2025, il divieto per i nonni di donare denaro ai nipoti, e persino la scoperta di un dodo gigante sotto i ghiacci antartici.

“Questi siti tendono a creare ‘allucinazioni’, esasperano fatti e notizie polarizzanti perché le persone sono più portate a cliccare se il titolo è sensazionalistico o inquietante”, spiega Manach.

Un fenomeno in espansione

Se la maggior parte dei siti è in francese, almeno un centinaio è già attivo in inglese, e secondo Manach questa sarebbe solo “la punta dell’iceberg”. I primi a muoversi hanno persino creato e venduto tutorial su YouTube su come “hackerare” Google Discover con l’IA.

Molti dei siti individuati sono gestiti da esperti SEO, alcuni ex editori che hanno sostituito i giornalisti con IA senza avvisare i lettori. I segnali ricorrenti? Autori inesistenti, assenza di crediti fotografici, contenuti senza fonti.

Google in difficoltà

Nonostante le dichiarazioni ufficiali, Google sembra incapace di filtrare efficacemente questi contenuti da Discover. Un portavoce ha dichiarato:

“I nostri sistemi anti-spam combattono aggressivamente i contenuti di bassa qualità, indipendentemente che siano creati da esseri umani o IA, mantenendo Search al 99% privo di spam”.

Ma i risultati sembrano dire altro. Google Discover, oggi fonte primaria di traffico per molti editori, continua a mostrare articoli artificiali nei feed degli utenti.

Il pericolo per il giornalismo (e la democrazia)

Per Manach il rischio va ben oltre la SEO. È una minaccia all’informazione e alla fiducia pubblica:

“Dobbiamo combattere questo inquinamento, perché minaccia il giornalismo, le nostre democrazie e il diritto di essere informati”.

Con il supporto dei suoi studenti e dei colleghi di Libération, il giornalista ha sviluppato una guida per riconoscere i siti IA e un’estensione browser per identificarli. Uno strumento utile non solo ai fact-checker ma anche ai lettori, sempre più esposti a contenuti sintetici che si autoalimentano.

“I giornalisti devono trovare nuovi modi per dimostrare che il loro lavoro è migliore di quello generato dall’IA”, conclude Manach. “Perché la differenza, oggi, non è solo nella fonte, ma nella responsabilità”.